Schon zu Recht überall durchgereicht, ist das doch für eine Enzyklika ungewöhnlich aktuell und trifft den Zeitgeist und die bevorstehenden Herausforderungen für unseren globalen und gesamtgesellschaftlichen Umgang mit Künstlicher Intelligenz, der Konzentration von Kapital und Macht doch sehr genau.

Hier z.B. Definition und Abgrenzung von KI [Absätze und Soft-Hyphens von mir für etwas bessere Lesbarkeit hinzugefügt; das Zitat ist im Original ein einzelner, langer Absatz (#99).]:

Es ist nicht möglich, eine eindeutige und umfassende Definition von Künstlicher Intelligenz zu geben. Fest steht jedoch, dass das Missverständnis zu vermeiden ist, diese „Intelligenz“ mit der menschlichen gleichzusetzen. Diese Systeme ahmen bestimmte Funktionen der menschlichen Intelligenz nach. Dabei übertreffen sie sie oft an Geschwindigkeit und Rechenleistung und bieten somit in zahlreichen Bereichen konkrete Vorteile. Diese Leistungsfähigkeit hat jedoch ausschließlich mit der Datenverarbeitung zu tun: Sogenannte Künstliche Intelligenzen machen keine Erfahrungen, besitzen keinen Leib, empfinden weder Freude noch Schmerz, reifen nicht in Beziehungen, wissen nicht von ihrem Inneren her, was Liebe, Arbeit, Freundschaft und Verantwortung bedeutet.

Sie haben auch kein moralisches Gewissen: Sie unterscheiden nicht zwischen Gut und Böse, sie erkennen nicht den eigentlichen Sinn von Situationen und sie nehmen die Last der Konsequenzen nicht auf sich. Sie können Sprache, Verhalten und Beurteilungen imitieren, sie können Empathie oder Verständnis simulieren, aber sie verstehen nicht, was sie damit bewirken, denn sie bewegen sich nicht in jenem affektiven, relationalen und geistigen Horizont, in dem der Mensch zur Weisheit gelangt.

Auch wenn diese Werkzeuge als „lernfähig“ dargestellt werden, unterscheidet sich ihre Art des Lernens von der einer menschlichen Person. Es handelt sich nicht um die Erfahrung eines Menschen, der sich vom Leben formen lässt und im Laufe der Zeit durch Entscheidungen, Fehler, Vergebung und Treue wächst; vielmehr ist es eine statistische Anpassung auf der Grundlage von Daten und Rückmeldungen, die zwar sehr effektiv sein kann, aber kein inneres Wachstum impliziert.

Und Tolkien zitiert er dann auch noch (#213).

—

Bevor ihr euch aber jetzt das sehr lange, sehr päpstliche Dokument durchlest, sei euch die Episode „API et Orbi“ von Haken dran vom vergangenen Freitag empfohlen, in der Gavin Karlmeier und Stefan Schulz sich der Einordnung des Papstes annehmen:

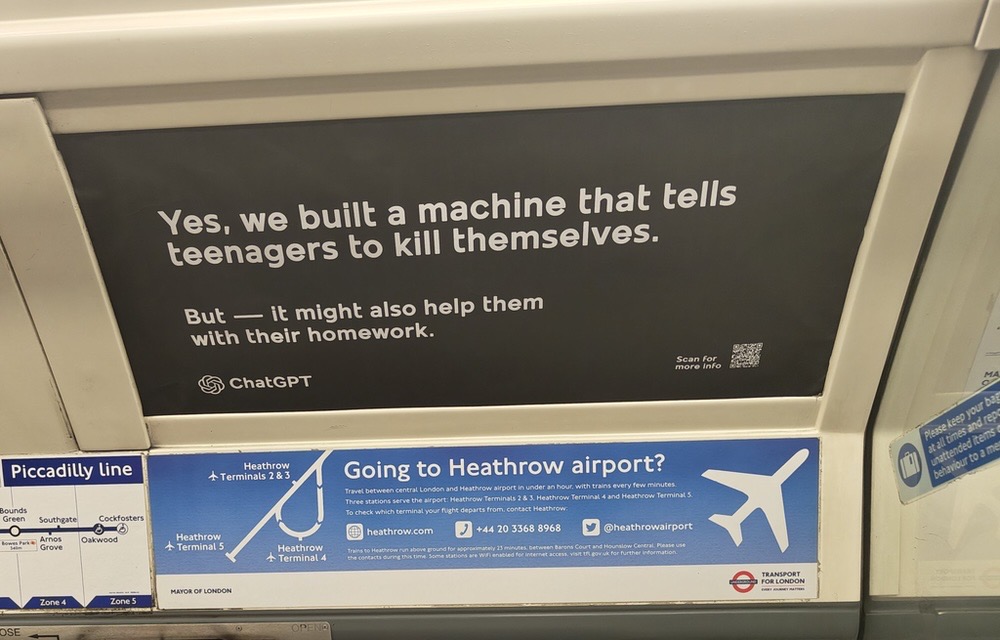

Wir versloppen uns zu Tode: Der Papst hat eine Meinung zu KI – und sie fällt sehr deutlich aus. Die KI ist kein Mensch, die Tech-Broligarchie ist moderner Kolonialismus, KI muss entwaffnet werden und unsere Daten gehören uns und nicht denen, die sie verarbeiten. Über diese Deutlichkeit, über den Widerstand, den wir dagegen aufbringen müssen […]. Der Podcast zum größten Raubzug der Menschheit gegen die Menschheit.

Darüber hinaus haben sich beide noch weiter mit der Thematik beschäftigt: Gavin in seinem Blogeintrag „Ist Claude ein ‚Kind Gottes‘?“ und Stefan in der aktuellen Ausgabe (hier z.B. auf YouTube) seines Podcasts Die neuen Zwanziger.